AI en de toekomst van werk: sneller, maar niet vanzelf beter

AI maakt kenniswerk sneller en soms beter. Maar mensgericht is pas echt mensgericht als we AI ontwerpen als digitale collega: helpend, begrensd, met ruimte voor menselijk oordeel. In dit artikel verken ik vier blinde vlekken - vooroordelen, vaardigheidsverlies, verbintenis en emotionele kosten - en wat beleid en ontwerp nu kunnen doen om werk waardig te houden. Als we AI alleen inzetten om harder te rennen, is het geen vooruitgang – dan is het een efficiëntere vorm van uitputting.

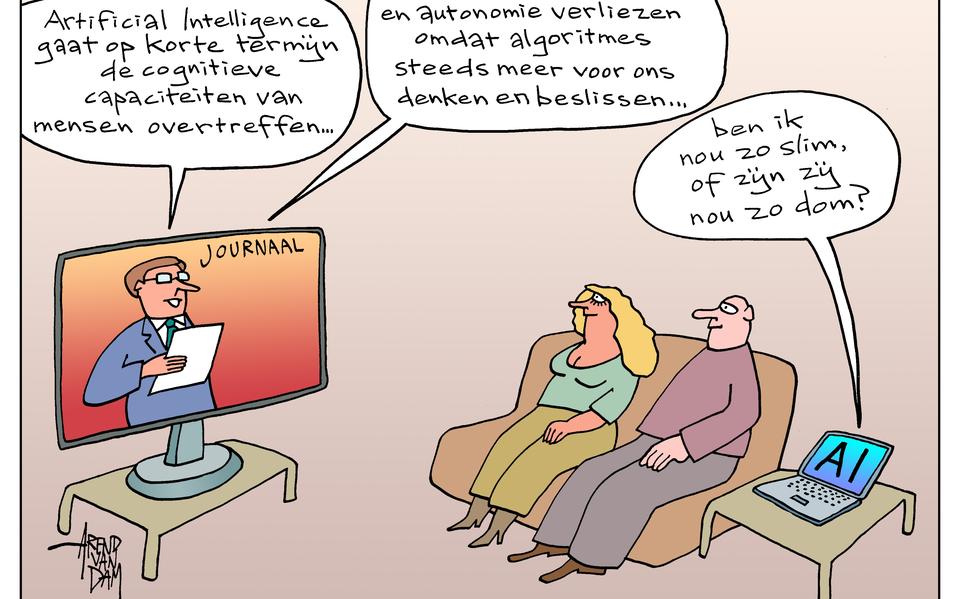

Afbeelding: Arend van Dam, bron: https://frieschdagblad.nl/samenleving/AI-28836429.html.

Een rapport dat vroeger een middag kostte, staat nu dankzij een AI-assistent – denk bijvoorbeeld aan ChatGPT, Copilot, en Claude – in twintig minuten op papier. Een e-mail die je normaal drie keer herschrijft, klinkt ineens “professioneel”. Een brainstorm die stilvalt, krijgt plots nieuwe energie dankzij opties die je nog niet had bedacht. Generatieve AI is in korte tijd van curiositeit naar gereedschap gegaan. Voor veel kenniswerkers voelt dat als winst: minder gedoe, meer tempo, soms zelfs betere kwaliteit.

Die winst is in veel onderzoek terug te zien. In een bekend experiment met professionele schrijftaken werkte een groep met ChatGPT gemiddeld veel sneller, en beoordeelden onafhankelijke beoordelaars de output als beter (1). Ook in organisaties waar AI op grote schaal werd uitgerold, bijvoorbeeld in customer support, steeg de productiviteit merkbaar, gemiddeld rond de 15% (2).

Maar snellere prestaties en zelfs kwalitatief sterkere output betekenen nog niet automatisch mensgerichter werk, zeker niet wanneer de minder zichtbare gevolgen pas later manifesteren (3). Precies daar zit vandaag de verwarring. In discussies over de toekomst van werk wordt vaak gedaan alsof efficiëntie automatisch leidt tot meer welzijn: minder tijdsdruk, meer ruimte, meer voldoening (4). Dat verband is in de praktijk allerminst vanzelfsprekend. Steeds vaker draait het gesprek daarom om een andere vraag: wat betekent het als AI niet alleen taken versnelt, maar ook de ervaring van werk hertekent, van trots en autonomie tot verbondenheid en het gevoel dat wat je doet ertoe doet?

Wat zou de term “mensgericht” moeten betekenen?

In het debat over de toekomst van werk duikt de term “mensgericht” (of in het Engels “human-centric”) vaak op. In de literatuur verwijst die term doorgaans naar een benadering van AI-ontwerp, -ontwikkeling en -gebruik die menselijke behoeften, waarden en belangen centraal probeert te stellen (5). Dat klinkt vanzelfsprekend positief, maar juist daarin schuilt het probleem. In de praktijk wordt “mensgericht” al snel gelijkgesteld aan aannames als: productiviteit is goed, efficiëntie schept vanzelf ruimte, en tijdswinst vertaalt zich automatisch in welzijn. Dat is allerminst zeker. Een striktere invulling helpt daarom. In deze bijdrage gebruik ik “mensgericht” niet voor AI die mensen simpelweg sneller of efficiënter laat werken, maar voor technologie die voorwaarden voor een waardig en betekenisvol werkleven daadwerkelijk beschermt en versterkt (6).

Daarbij is het nuttig om een klassiek psychologisch uitgangspunt serieus te nemen: mensen floreren niet alleen door resultaat, maar ook door hoe dat resultaat tot stand komt. Self-Determination Theory beschrijft autonomie, competentie en verbondenheid als basisbehoeften die motivatie en welzijn ondersteunen (7). Als AI de ruimte voor keuze en oordeel vergroot, groei ondersteunt en samenwerking verdiept, kan het werk menselijker worden. Als AI vooral leidt tot meer controle, minder leerruimte en dunner sociaal contact, kan dezelfde technologie het werk juist ontmenselijken (8). Denk aan een consultant die met hulp van AI snel een helder rapport opstelt. Dat lijkt efficiënt en behulpzaam. Maar zodra AI niet alleen helpt formuleren, maar ook een groot deel van het denkwerk overneemt, dringen zich andere vragen op. Wat leert deze medewerker nog? En wat voegt hij of zij nog toe aan het werkproces?

Hoe kan AI menselijke vooruitgang tegenwerken?

AI kan werk makkelijker maken, maar dat betekent niet automatisch dat het werk ook beter wordt voor mensen. De belangrijkste gevolgen zitten vaak niet in de output, maar in wat er onder de motorkap verandert: wie profiteert, wat mensen nog leren, hoe we met elkaar samenwerken, alsook de emoties die we bij ons werk ervaren. Daarom zoom ik nu in op vier sociale thema’s: vooroordelen, vaardigheidsverlies, menselijke verbintenis en emotionele kosten.

Vooroordelen. Het meest sprekende voorbeeld is dat zelfs een kunstmatige assistent niet ontsnapt aan menselijke vooroordelen. In een Zwitsers experiment kregen werknemers op hun eigen werkplek hulp aangeboden van een AI met een mannelijk of vrouwelijk voorkomen die exact hetzelfde werk deed, maar de vrouwelijke AI werd gemiddeld 10% minder “betaald” – een fictieve beloning voor het verrichte werk – dan de mannelijke variant (9). Dat is meer dan een curiositeit. Zodra we AI een gezicht, naam of stem geven, ontwerpen we niet alleen technologie, maar reproduceren we ook sociale rollen (10). In lijn daarmee laat ander onderzoek zien dat gender-labels onze omgang met AI sturen. In een online Prisoner’s Dilemma-studie werd AI met een vrouwelijk label vaker geëxploiteerd, terwijl AI met een mannelijk label vaker werd gewantrouwd (11). Zulke bevindingen suggereren dat AI niet alleen menselijke vooroordelen weerspiegelt, maar ook interacties mogelijk maakt waarin minder sociale remming optreedt. Juist omdat AI ons niet op dezelfde manier confronteert met ons eigen gedrag als een mens dat zou doen, ontstaat het risico dat we ons in het gebruik ervan moreel gezien eerder verliezen dan corrigeren.

Bias zit bovendien niet alleen in hoe mensen AI benaderen, maar ook in wat AI teruggeeft én in hoe AI-gebruik sociaal wordt gewaardeerd. Een groeiend onderzoeksveld kijkt naar AI-advies over salaris, loopbaanstappen en sollicitaties. Een onderzoeksgroep aan THWS (Würzburg-Schweinfurt) rapporteerde bijvoorbeeld dat taalmodellen vrouwen systematisch lagere salarisdoelen adviseren dan mannen, zelfs bij verder gelijke profielen (12). Dit type bias is verraderlijk omdat het verpakt is als behulpzaamheid. Het advies klinkt plausibel en objectief, en kan zo ongelijkheid normaliseren. Dat betekent tegelijk niet dat AI per definitie meer bias produceert dan menselijke beoordelaars. In domeinen zoals selectie en werving wordt AI juist ook gezien als een manier om beslissingen sterker te standaardiseren en bepaalde vormen van menselijke willekeur of bias te beperken (13). De relevante vraag is daarom niet of AI objectief is, maar onder welke voorwaarden het ongelijkheid daadwerkelijk vermindert in plaats van reproduceert. Zo toont een recente PNAS-studie uit 2025 aan dat AI-gebruik een evaluatie-penalty kan opleveren, waarbij anderen gebruikers negatiever beoordelen op competentie of motivatie (14). In aanvullend werk rond een “competence penalty” lijkt die reputatieschade zelfs sterker te kunnen zijn voor vrouwen in technische contexten, ondanks identieke output (15). Samen schetsen deze bevindingen een ongemakkelijke dynamiek: AI kan prestaties verhogen, terwijl de sociale en verdelingskosten ongelijk terechtkomen.

Vaardigheidsverlies. AI is bij uitstek een technologie die uitnodigt tot “cognitieve uitbesteding” – het uit handen geven van mentale stappen. Dat is vaak rationeel – waarom zou je elke zin opnieuw uitvinden? – maar het heeft een keerzijde als het structureel wordt. In een survey van kenniswerkers onderzocht Microsoft wanneer mensen nog kritisch denken tijdens AI gebruik. De resultaten suggereren dat AI bij veel taken de ervaren cognitieve inspanning verlaagt, en dat mensen soms minder geneigd zijn om zelf diep te redeneren (16). Een theoretisch perspectiefstuk over “skill decay” waarschuwt daarnaast dat AI-assistenten vaardigheidsopbouw bij beginners kunnen hinderen en bij experts vaardigheden kunnen laten wegzakken, juist omdat AI-assistenten ongemerkt die moeilijke kernstappen overnemen (17).

Belangrijk is dat dit niet alleen over “intelligentie” gaat, maar over beroepsvorming. Jonge werknemers leren vaak door het zelf te doen, of het nou gaat om een eerste lastige memo, een moeilijke klantencase, of een analyse die niet meteen klopt. Als AI standaard de eerste versie levert, is de vraag welke leercurve overblijft. De zorg is niet dat mensen op korte termijn niets meer kunnen, maar dat expertise zich op langere termijn anders ontwikkelt. Juist doordat AI de moeilijke tussenstappen overneemt, oefenen mensen minder waar normaal vakmanschap en professioneel oordeel worden opgebouwd. Een groeiende literatuur over afhankelijkheid van AI, vooral in leercontexten maar met duidelijke parallellen naar werk, laat zien dat overmatig leunen op zulke systemen samen kan gaan met zwakkere kritische cognitieve vaardigheden (18).

Menselijke verbintenis. Werk is niet alleen productie; het is ook sociale infrastructuur (19). Informeel advies, erkenning, humor, conflict oplossen, elkaar “lezen”. Hier kan AI op twee manieren frictie creëren. De eerste is subtiel: als AI de standaard sparringpartner wordt, kan dat op korte termijn tijd besparen maar op langere termijn ook sociale connecties verdringen. Daardoor verdwijnen juist de kleine momenten van overleg, afstemming en erkenning waarin werkrelaties normaal worden opgebouwd en onderhouden. De tweede is structureler: in omgevingen waar AI werk toewijst, monitort en beoordeelt, rapporteren onderzoekers psychosociale risico’s zoals intensivering, minder beslissingsruimte en sociale isolatie (20). Dat sociale verlies kan bovendien verder reiken dan de werkvloer. Uitgebreid onderzoek heeft laten zien dat intensiever werken met AI samenhangt met meer gevoelens van eenzaamheid, wat vervolgens gepaard gaat met ongezondere ‘spillover’ na werktijd, waaronder meer alcoholconsumptie en meer slaapproblemen (21).

Een longitudinale experience-sampling studie in de service-industrie vond tevens dat samenwerking met AI kan samenhangen met werkvervreemding, een gevoel van disconnectie met het werk, wat vervolgens de kans op afraffelgedrag verhoogt (22). Dat is precies het soort mechanisme waardoor efficiëntie een pyrrusoverwinning kan worden: je wint tempo, maar verliest betrokkenheid, waardoor kwaliteit en integriteit op termijn onder druk komen.

Emotionele kosten. Tot slot kan AI de emotionele opbrengst van presteren aantasten. Uit het voorgenoemde Zwitserse onderzoek leren we dat AI-assistenten het gevoel van psychologisch eigenaarschap – het gevoel “dit was mijn werk” – verminderen en dat dit samenhangt met lagere werktevredenheid, zelfs wanneer de output objectief goed is (23). Wanneer een substantieel deel van de prestatie aan het systeem wordt toegeschreven, voelt succes ook minder als iets dat echt van jezelf is. Tegelijkertijd toont ander onderzoek aan dat medewerkers sneller succes op het werk kunnen krijgen dankzij AI, maar dat ze zich minder trots voelen, wat doorwerkt in hoe waardevol en competent ze zichzelf op het werk ervaren (24). Dit sluit ook aan bij recent onderzoek dat laat zien dat schrijven met AI gemiddeld lager eigenaarschap oproept maar dat meer eigen inbreng (bijv. langere, inhoudelijkere prompts) dat deels herstellen (25).

Samen laten deze vier thema’s zien dat AI werk weliswaar efficiënter kan maken, maar tegelijk ook precies die menselijke voorwaarden onder druk kan zetten die werk draaglijk, leerzaam en betekenisvol maken. Als dat de risico’s zijn, dringt zich ook een volgende vraag op.

Hoe voorkomen we dat AI werk ontmenselijkt?

Wat nu telt, is dat we AI niet langer behandelen als “een handige tool”, maar als een nieuwe laag in de organisatie: eentje die meeschrijft, mee-adviseert, mee-beoordeelt en soms zelfs meestuurt. Dat vraagt om een stap die in veel organisaties nog ontbreekt: weg van losse experimenten richting bewust ontwerp. Concreet betekent dit dat we werkprocessen zo inrichten dat AI-ongelijkheid niet reproduceert, leren niet uitholt, sociale relaties niet vervangt, en de emotionele opbrengst van presteren niet ongemerkt afroomt.

Die stap is praktischer dan hij klinkt. In plaats van AI uitsluitend te framen als een neutraal werktuig, kun je het beter behandelen als een mogelijke samenwerkingspartner met een duidelijke rolverdeling: een “digitale collega” die helpt, maar absoluut niet overneemt. Onderzoek suggereert dat het in sommige contexten behulpzaam kan zijn om AI te positioneren als een digitale collega, wat kan bijdragen aan betere werkrelaties (26) en een positievere beleving van het werk (27). Het gaat hier niet om het romantiseren van technologie, noch om het promoten van organisaties die gerund worden door AI-systemen, maar om het serieus nemen van een hele simpele realiteit: zodra een systeem taal gebruikt, advies geeft en keuzes beïnvloedt, gaan mensen er sociaal op reageren.

Als je AI als een werknemer kadert, volgt daar ook een ontwerpprincipe uit waar ruimte is voor menselijke tekortkomingen en interpersoonlijke frictie. Een “te perfecte” assistent die altijd direct instemt en elke wens zo snel mogelijk uitvoert maakt het verleidelijk om denkwerk uit te besteden. Imperfectie, onzekerheid en tegenspraak zijn dus functioneel. Ze nodigen mensen uit om zelf te beoordelen, te corrigeren en verantwoordelijkheid te nemen. Dat sluit aan bij het IKEA-effect: resultaten voelen waardevoller wanneer je er zelf merkbare arbeid en vakmanschap in hebt gestopt (28). Als AI alles gladstrijkt, kan werk efficiënter worden maar psychologisch armer. Dat betekent niet dat organisaties bewust slechtere systemen moeten implementeren, maar wel dat zij AI zo kunnen inzetten dat menselijke tussenstappen behouden blijven. Denk bijvoorbeeld aan systemen die meerdere opties geven in plaats van één pasklaar antwoord, die gebruikers vragen om keuzes te motiveren, of die advies geven zonder meteen de beslissing over te nemen. Dat betekent dat AI niet al het denkwerk moet willen oplossen, zodat mensen zelf betrokken, scherp en verantwoordelijk blijven.

Verder blijft het essentieel om bewust menselijke kernstappen te beschermen waar vakmanschap groeit en betekenis ontstaat. Hiervoor zijn grenzen nodig over wanneer AI-advies niet leidend mag zijn (bijvoorbeeld bij selectie, beoordeling en beloning), hoe transparantie en verantwoordelijkheid geregeld moeten zijn, en hoe bias in output én in de evaluatie van gebruikers wordt tegengegaan. En minstens zo belangrijk is het investeren in wat technologie niet kan vervangen – mentoring, conflictoplossing, erkenning, empathie – de sociale infrastructuur die werk menselijk maakt.

De toekomst van werk met AI is daarom niet primair een technologisch vraagstuk. Het is een menselijk vraagstuk dat via technologie zichtbaar wordt. AI kan werk sneller maken en soms ook beter. Maar menselijke vooruitgang vraagt meer dan snelheid. Ze vraagt gelijkwaardigheid, vaardigheid, verbinding, en zingeving. Precies daar moet de komende golf van beleid, ontwerp en onderzoek op gericht zijn. Als AI werk vooral sneller en efficiënter maakt, maar niet mensgerichter, dan is dat geen vooruitgang maar geoptimaliseerde uitputting.

Referenties

1) Noy, S., & Zhang, W. (2023). Experimental evidence on the productivity effects of generative artificial intelligence. Science, 381(6654), 187–192.

2) Brynjolfsson, E., Li, D., & Raymond, L. R. (2025). Generative AI at Work. The Quarterly Journal of Economics, 140(2), 889–942

3) Passalacqua, M., Pellerin, R., Magnani, F., Joblot, L., Rosin, F., Yahia, E., & Léger, P.-M. (2025). Safeguarding worker psychosocial well-being in the age of AI: The critical role of decision control. International Journal of Human-Computer Studies, 205, 103649.

4) Isham, A., Mair, S., & Jackson, T. (2021). Worker wellbeing and productivity in advanced economies: Re-examining the link. Ecological Economics, 184, 106989.

5) Schmager, S., Pappas, I. O., & Vassilakopoulou, P. (2025). Understanding Human-Centred AI: a review of its defining elements and a research agenda. Behaviour & Information Technology, 1-40.

6) OECD, AI Principles. https://www.oecd.org/en/topics/sub-issues/ai-principles.html?utm_source=...

7) Deci, E. L., & Ryan, R. M. (2000). The" what" and" why" of goal pursuits: Human needs and the self-determination of behavior. Psychological Inquiry, 11(4), 227-268.

8) Kellogg, K. C., Valentine, M. A., & Christin, A. (2020). Algorithms at work: The new contested terrain of control. Academy of Management Annals, 14(1), 366-410.

9) Gyssels, A. & Geussens, S. (2025). Ook een ‘vrouwelijke’ AI- chatbot verdient minder dan haar mannelijke collega. Nieuwsblad.

10) Brahnam, S., & De Angeli, A. (2012). Gender affordances of conversational agents. Interacting with Computers, 24(3), 139-153.

11) Bazazi, S., Karpus, J., & Yasseri, T. (2025). AI’s assigned gender affects human-AI cooperation. Iscience, 28(12).

12) Sorokovikova, A., Chizhov, P., Eremenko, I., & Yamshchikov, I. P. (2025). Surface Fairness, Deep Bias: A Comparative Study of Bias in Language Models. arXiv preprint arXiv:2506.10491.

13) Wilkens, U., Lutzeyer, I., Zheng, C., Beser, A., & Prilla, M. (2025). Augmenting diversity in hiring decisions with artificial intelligence tools. The International Journal of Human Resource Management, 36(14), 2585-2622.

14) Reif, J. A., Larrick, R. P., & Soll, J. B. (2025). Evidence of a social evaluation penalty for using AI. Proceedings of the National Academy of Sciences, 122(19), e2426766122.

15) Gai, P. J., Hou, J., & Tu, Y. (2025). Competence Penalty Is a Barrier to the Adoption of New Technology. Available at SSRN 5255039.

16) Lee, H. P., Sarkar, A., Tankelevitch, L., Drosos, I., Rintel, S., Banks, R., & Wilson, N. (2025, April). The impact of generative AI on critical thinking: Self-reported reductions in cognitive effort and confidence effects from a survey of knowledge workers. In Proceedings of the 2025 CHI conference on human factors in computing systems (pp. 1-22).

17) Macnamara, B. N., Berber, I., Çavuşoğlu, M. C., Krupinski, E. A., Nallapareddy, N., Nelson, N. E., ... & Ray, S. (2024). Does using artificial intelligence assistance accelerate skill decay and hinder skill development without performers’ awareness?. Cognitive Research: Principles and Implications, 9(1), 46.

18) Zhai, C., Wibowo, S., & Li, L. D. (2024). The effects of over-reliance on AI dialogue systems on students' cognitive abilities: a systematic review. Smart Learning Environments, 11(1), 28.

19) Baumeister, R. F., & Leary, M. R. (1995). The need to belong: Desire for interpersonal attachments as a fundamental human motivation. Psychological Bulletin, 117, 497-529.

20) Tang, P. M., Koopman, J., Mai, K. M., De Cremer, D., Zhang, J. H., Reynders, P., ... & Chen, I. (2023). No person is an island: Unpacking the work and after-work consequences of interacting with artificial intelligence. Journal of Applied Psychology, 108(11), 1766.

21) Cremer, D. D., & Koopman, J. (2024). Research: Using AI at Work Makes Us Lonelier and Less Healthy. Harvard Business Review, 24.

22) Hai, S., Long, T., Honora, A., Japutra, A., & Guo, T. (2025). The dark side of employee-generative AI collaboration in the workplace: An investigation on work alienation and employee expediency. International Journal of Information Management, 83, 102905.

23) van Zelderen, A. P. A., & Menges, J. I. (2025). Crediting AI to Enhance Job Satisfaction: AI Assistants as Distinct Organizational Performers. In Academy of Management Proceedings (Vol. 2025, No. 1, p. 13623). Valhalla, NY 10595: Academy of Management.

24) Campbell, A. V., Wang, Y., & Inzlicht, M. (2025). Experimental evidence that exerting effort increases meaning. Cognition, 257, 106065.

25) Joshi, N., & Vogel, D. (2025, July). Writing with ai lowers psychological ownership, but longer prompts can help. In Proceedings of the 7th ACM Conference on Conversational User Interfaces (pp. 1-17).

26) Einola, K., Khoreva, V., & Tienari, J. (2024). A colleague named Max: A critical inquiry into affects when an anthropomorphised AI (ro) bot enters the workplace. Human Relations, 77(11), 1620-1649.

27) van Zelderen, A. P., Wu, S., Koszo, G., & Menges, J. I. (2025). When AI gets Personal: Employee emotional responses to anthropomorphic AI agents in a virtual workspace. Computers in Human Behavior: Artificial Humans, 100189.

28) Norton, M. I., Mochon, D., & Ariely, D. (2012). The IKEA effect: When labor leads to love. Journal of Consumer Psychology, 22(3), 453-460.